4 октября 2023 г. в Санкт-Петербургском государственном университете в рамках VI международного форума «Россия и Ибероамерика в турбулентном мире: история и современность» состоялась презентация коллективной монографии «The Palgrave Handbook of Malicious Use of AI and Psychological Security» (Руководство «Пэлгрейв» по проблемам злонамеренного использования искусственного интеллекта и информационно-психологической безопасности») под. ред. Е.Н. Пашенцева.

Выступление редактора и соавтора издания, ведущего научного сотрудника ИАМП ДА МИД РФ, доктора исторических наук, проф. Евгения Николаевича Пашенцева началось с подведения итогов работы над коллективной монографией. Е.Н. Пашенцев подчеркнул, что выходу книги предшествовала четырёхлетняя работа международной группы по исследованию угроз международной информационно-психологической безопасности посредством злонамеренного использования искусственного интеллекта (ИИ), которая была создана на научно-практическом семинаре, прошедшем в Институте актуальных международных проблем Дипломатической Академии МИД РФ в июне 2019 г. Важно отметить, что авторами глав монографии стали 23 исследователя из 11 стран мира, включая специалистов из Индии, Китая, России и США, представляющих как общественные, так и технические науки. Было упомянуто, что монография уже с успехом была представлена в Китае в рамках симпозиума, организованного Школой международных отношений и редакцией журнала «Исследования международной безопасности» Университета международных отношений Пекина. Предполагается ее презентация в Индии, и ряде других стран БРИКС.

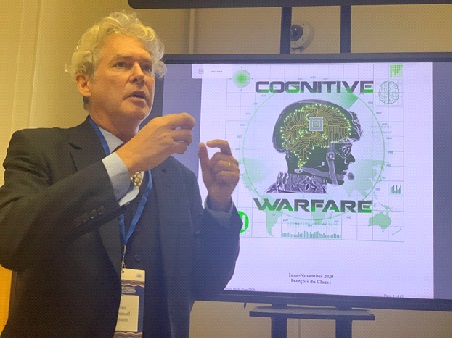

Выступление редактора и соавтора издания, ведущего научного сотрудника ИАМП ДА МИД РФ, доктора исторических наук, проф. Евгения Николаевича Пашенцева

В своем выступлении Е.Н. Пашенцев заострил внимание на современных и перспективных угрозах информационно-психологической безопасности, создаваемых как государственными, так и негосударственными злонамеренными акторами посредством технологий ИИ. Целью такого злонамеренного использования является получение количественного и, все более, качественного преимуществ в информационно-психологическом противоборстве и через это перераспределения материальных и нематериальных активов в свою пользу. Качественно более высокий уровень информационно-психологического воздействия может привести в недалеком будущем к качественно более высокому, чем позволяла до сих пор пропаганда, уровню контроля злонамеренных акторов над целевыми группами населения по всему миру.

Потенциал злонамеренного использования ИИ сегодня вызывает растущую тревогу. Проф. Пашенцев привел такой пример: исследователи из швейцарской Collaborations Pharmaceuticals в сотрудничестве с европейскими исследовательскими институтами провели концептуальный эксперимент. Вместо того чтобы синтезировать новые лекарства, они запрограммировали нейронную сеть MegaSyn AI на прямо противоположный результат: определить вещества, которые наиболее токсичны для человеческого организма. Нейронная сеть правильно поняла задачу и менее чем за шесть часов сгенерировала список из 40 тыс. веществ — оптимальных компонентов химического и биологического оружия. ИИ самостоятельно разработал не только многие известные боевые отравляющие вещества, но и множество новых, более токсичных. Простая инверсия посредством машинного обучения превратила безвредную генеративную модель из полезного инструмента в средство массового убийства. Можно предположить, что этот инверсионный подход может быть применен и к другим областям, таким как поиск оптимальных способов негативного информационно-психологического воздействия на общественное сознание.

Другой пример, который привел Е.Н. Пашенцев, связан с тем, как ошибочное истолкование выступления Али Бонго, президента Габона, как дипфейка привело к попытке военного переворота еще в 2019 г., а избранный президентом Южной Кореи от консервативной партии «Сила народа» Юн Сок Ёль во время своей избирательной кампании 2022 г. успешно применил необычную стратегию, основанную на использовании технологии дипфейк. Политик получил цифрового двойника, который мог выступать в нескольких местах одновременно и делал это, по мнению ряда экспертов, далее более успешно, чем сам кандидат. Ученые Чикагского университета показали, что чат-бот ChatGPT, разработанный компанией OpenAI, способен настолько хорошо генерировать рефераты, посвященные медицинским научным темам, что эксперты не всегда могут отличить его работу от работы человека. При слепом рецензировании каждый третий реферат, написанный ChatGPT, эксперты приписывают человеку. Все эти и многие другие возможности могут быть целенаправленно использованы во вред человеку, что требует системного ответа в политическом, социальном, правовом, техническом поле и развития гибридных форм интеллекта с новыми колоссальными возможностями и темпами развития, новым уровнем социальной ответственности человека в новом обществе, истоки которого закладываются уже сегодня. Но это общество не гарантировано (чего стоит только угроза мировой войны или экологическая катастрофа) и имеет многовариантность форм осуществления (включая антигуманные в своей основе варианты).

С презентацией главы монографии «Геополитическая конкуренция и проблемы Европейского Союза в противодействии злонамеренному использованию искусственного интеллекта» выступил эксперт в сфере геополитики, профессор Института социальных, экономических и политических исследований (Лион, Франция), президент политологической ассоциации «Евроконтинент» (Брюссель, Бельгия) доктор Пьер-Эммануэль Томанн.

Выступление президента политологической ассоциации «Евроконтинент» (Брюссель, Бельгия) доктор Пьер-Эммануэля Томанна

В своем докладе он подчеркнул, что в условиях крушения однополярной системы мира геополитическое противостояние все чаще происходит на театре гибридной войны, в том числе информационно-психологической. Новая мишень геополитики – сам мозг человека, и контроль над этой мишенью будет сочетаться с контролем над территориями. На сегодняшний день когнитивное противоборство выходит за рамки информационного противоборства, поскольку его цель – повлиять не на то, о чем люди думают, а на то, как они думают.

Пьер-Эммануэль Томанн отмечает, что современный геополитический дисбаланс вызван неравным доступом к ИИ и сбору данных. ЕС сталкивается с потенциальным возникновением новой биполярности в области ИИ, в которой доминируют США и Китай. Позиция ЕС в отношении ИИ, сконцентрированная лишь на его этических и экономических аспектах, не вносит позитивный вклад в улучшение равновесия в международных отношениях.

Различия между странами-членами ЕС в их геополитическом восприятии мира, стратегиях в области ИИ и цифровизации в целом являются препятствием для создания международного сотрудничества с другими глобальными акторами, такими, как США, Китай и Россия, для противодействия международным информационно-психологическим операциям и защиты международной информационно-психологической безопасности.

Кроме того, технологический альянс ЕС с США рискует усилить глобальную геополитическую фрагментацию на антагонистические блоки. На сегодняшний день между США и ЕС еще много разногласий и такой подход может стать препятствием для глобальных переговоров по эффективной борьбе в области международной информационно-психологической безопасности на тактическом, и особенно на стратегическом уровне.

П.-Э. Томанн считает, что для обретения суверенитета ЕС, который позиционирует себя как региональный игрок, способствующий развитию сотрудничества, необходимо пересмотреть свои позиции в отношении глобальных игроков России и Китая для укрепления трансатлантических отношений в области внешней технической политики.

Главу «Современные и будущие угрозы злонамеренного использования ИИ террористами: информационно-психологические аспекты» представила доктор политических наук, ведущий научный сотрудник Института Европы РАН Дарья Юрьевна Базаркина.

Выступление доктора политических наук, ведущего научного сотрудника Института Европы РАН Дарьи Юрьевны Базаркиной

В своем докладе она акцентировала внимание слушателей на антисоциальном проявлении социальной инженерии, используемой различными террористическими организациями для информационно-психологического воздействия на целевые аудитории при помощи ИИ технологий.

Докладчица отметила, что социальная инженерия является способом заставить общественность или конкретного человека поверить в ложную информацию, который активно используется террористами для продвижения своей идеологии. В качестве примера Д. Ю. Базаркина приводит злонамеренное использование ботов в 2015 году, когда запрещенная в России террористическая организация «Исламское государство» создала тысячи ботов в Twitter для пропаганды, развлечения и вербовки своих активистов.

Было также подчеркнуто, что, используя реалистичность и привлекательность игрового процесса, управляемого ИИ, который удерживает внимание игрока, злоумышленники могут редактировать пропаганду контента с использованием кадров из современных игр для более эффективного воздействия на целевые аудитории. Да и сами технологии разработки игр со временем могут стать доступными для террористических организаций.

Подводя итоги, Д.Ю. Базаркина сделала вывод, что для минимизации экономических и социально-психологических факторов, приводящих к вовлечению специалистов в области ИИ в террористическую деятельность, необходима более детальная разработка планов и стратегий ИИ в разных странах, включая социальную составляющую этих стратегий.

С презентацией главы «Злонамеренное использование искусственного интеллекта в политических кампаниях: вызовы для международной информационно-психологической безопасности на ближайшие десятилетия» выступил преподаватель Национальной школы политических и административных исследований Бухареста д-р Мариус Вакарелу. По его мнению, на сегодняшний день технологии ИИ представляют собой широкие возможности для применения их в политических кампаниях для влияния на выборы и формирования новых мнений в период голосования посредством более скрытых методов убеждения и манипуляций.

Выступление преподавателя Национальной школы политических и административных исследований Бухареста д-р Мариуса Вакарелу

ИИ может предоставить полезные данные для стратегов политических кампаний: определить целевого избирателя, который проголосует за конкретного кандидата, отследить количество рекламных объявлений, их географическую локацию и время показа, создать персональные сообщения для отдельных избирателей с помощью объема данных, полученных из сообщений в социальных сетях.

Вместе с тем, существует угроза, связанная с неправильным использованием ИИ, превращающим его в инструмент для экономических, промышленных, образовательных и медицинских манипуляций в руках любого агрессора.

Д-р М. Вакарелу приходит к выводу, что национальные документы по вопросам внедрения ИИ создадут конкретную административную структуру для мониторинга практики его использования.

Глава «Риторика ненависти в управлении восприятием кампании: новые возможности анализа настроений и аффективных вычислений» была представлена недавним выпускником аспирантуры, а ныне ассистентом факультета международных отношений СПбГУ Юрием Юрьевичем Колотаевым, который сосредоточил внимание на изучении злонамеренного использования ИИ в распространении языка вражды в социальных сетях, рассмотрев методы аффективного вычисления и анализ настроений.

Выступление ассистента факультета международных отношений СПбГУ Юрия Юрьевича Колотаева

Ю. Ю. Колотаев отметил, что оба подхода применяются для выявления языка вражды в социальных сетях. Однако, несмотря на множество положительных последствий (например, автоматическое обнаружение дезинформации и вредоносного контента), дальнейшее развитие ИИ может также стать инструментом для проведения кампаний по управлению восприятием, направленных на определенную аудиторию.

Глава основана на сценарном анализе и включает оценку существующих примеров, рисков и мер противодействия, связанных с угрозой для международной информационно-психологической безопасности распространения языка вражды.

Коллективная монография «Руководство «Пэлгрейв» по проблемам злонамеренного использования искусственного интеллекта и информационно-психологической безопасности» получила положительные рецензии мировых экспертов в профильных областях.

В рамках презентации с экспертной оценкой выступил доцент кафедры коммуникативистики Университета Туриба доктор Грег Саймонс, который отметил актуальность проведенного исследования в условиях глобальной геополитической трансформации от западоцентричного однополярного порядка под руководством США к незападноцентричному многополярному порядку. Д-р Саймонс отметил, что, когда такие переходы происходят, они сопровождаются усилением конкуренции и борьбы за власть, влияние и выгодное положение в будущем. Потенциально этим можно управлять, действуя в пятом измерении стратегии в нынешнем контексте информационного века, когда знания и информация являются возможным национальным или международным источником власти и влияния.

Выступление доцента кафедры коммуникативистики Университета Туриба доктора Грега Саймонса

Грег Саймонс поздравил весь международный коллектив авторов с выходом в свет актуального научного труда и подчеркнул важность данного исследования для специалистов из разных стран мира для формирования научно-практической базы в области информационно-психологической безопасности.

Высокую экспертную оценку монографии дал также доктор политических наук, профессор кафедры теории и истории международных отношений СПбГУ Константин Арсеньевич Панцерев. Он подчеркнул важность выхода монографии, где подробно изучены вызовы и угрозы от злонамеренного использования технологий ИИ исследователями из разных стран мира, особенно в нынешней международной ситуации.

Выступление доктора политических наук, профессора кафедры теории и истории международных отношений СПбГУ Константина Арсеньевича Панцерева

С аннотациями всех глав монографии можно ознакомиться на сайте https://link.springer.com/book/10.1007/978-3-031-22552-9

Читайте другие материалы журнала «Международная жизнь» на нашем канале Яндекс.Дзен.

Подписывайтесь на наш Telegram – канал: https://t.me/interaffairs

Подписывайтесь на наш канал в мессенджере MAX

15:18 18.10.2023 •

15:18 18.10.2023 •