Американский боевой робот «Гладиатор»

Крупнейший международный форум ученых - 24-я Международная объединенная конференция по искусственному интеллекту[1] - высказался против создания боевых роботов с искусственным интеллектом. Более 1000 участников этого форума подписали открытое письмо против «гонки вооружений в области военного применения ИИ» и за запрет «наступательного автономного оружия». В числе тех, кто подписал письмо: основатель «Tesla» Элон Маск, со-основатель «Apple» Стив Возняк, знаменитый физик Стивен Хокинг, и основатель компании «DeepMind», добившейся в создании искусственного интеллекта значительных успехов, Демис Хассабис.

В письме содержится призыв отказаться от использования искусственного интеллекта (ИИ) при создании боевой техники, а также предостережение, что гонка подобных вооружений приведет к непредсказуемым последствиям: «Технологии искусственного интеллекта достигли такого уровня, что развертывание [автономного оружия] — пусть пока не с юридической, но с практической точки зрения — возможно в течении нескольких лет, и ставки высоки: автономное оружие рассматривается как третья глобальная революция в военном деле, после пороха и атомной бомбы»[2]

Авторы письма, известные ученые полагают, что как только одна из великих держав начнет производить такие военные системы, другие страны немедленно последуют этому примеру и начнется новая, во многом фатальная по последствиям, гонка вооружений: «Если какая-либо крупная военная держава попытается вырваться вперед в развитии оружия с искусственным интеллектом, то глобальная гонка вооружений практически неизбежна»[3]. В отличие от ядерного оружия, указывается в письме, военные роботы с ИИ не требуют дорого или трудно получаемого сырья и, таким образом, их производство будет дешево для всех крупных военных держав и развернут повсеместно их массовое производство.

В письме особо подчеркнуто, что «так же, как большинство химиков и биологов не видят никакого интереса в создании химического или биологического оружия, большинство исследователей ИИ никак не заинтересованы в создании ИИ оружия с искусственным интеллектом»[4].

Ученые категорически отвергают мысль о том, что автономное оружие, управляемое искусственным интеллектом, снизит количество человеческих жертв во время военных конфликтов. По мнению лучших в мире специалистов по ИИ, напротив, роботы будут склонны открывать огонь раньше, чем это сделали бы люди, что приведет только к еще большим и неоправданным жертвам. «Конец этой технологической траектории ясен: автономное оружие станет новым “автоматом Калашникова”. Ключевой вопрос для человечества сейчас состоит в том, начинать ли гонку вооружений в области военного применения ИИ, или отказаться от этого»[5], - полагают ученые. В письме они призвали ООН, другие влиятельные организации сделать все, чтобы отказаться от военного применения роботов с искусственным интеллектом. «В целом, мы считаем, что Искусственный Интеллект имеет большой потенциал, чтобы принести во многом, пользу человечеству, и в этом наша цель оправдывает средства. Начинать гонку вооружений в сфере ИИ является плохой идеей, и должно быть предотвращено в виде запрета на автономные наступательные вооружения за пределами значимого человеческого контроля (выделено мной – Г.П.)»[6] - заключает воззвание ученых.

Что же такое автономное оружие? Автономное оружие может выбирать и поражать цели без вмешательства человека. Это военная вооруженная платформа перемещающая по воздуху, по земле или воде, снабженная разнообразными сенсорами и датчиками и кибернетическим устройством искусственного интеллекта, способная по своему усмотрению, без контроля со стороны человека, ориентироваться и передвигаться на местности, находить цель и переходить к уничтожению живой силы и техники противника в соответствии с оперативно-тактическими планами своего командования. Принято сегодня этот вид вооружений называть LARS (Lethal autonomous robotics) — смертельные автономные роботы.

Международные дискуссии о запрете автономного оружия

Дискуссии на тему безопасности в области разработки военных роботов нового поколения ведутся давно и все чаще выходят на самый высокий, международный уровень. Так, вопрос об автономном оружии обсуждается в ООН уже не первый год. ООН рассматривает возможность запрета определенных типов автономных боевых систем, объясняя это тем, что они могут быть запрограммированы как на уничтожение целей, так и на убийство людей. В отличие от БПЛА на поле боя эти военные машины работают автономно.

В 2013 году ООН поручил своему эксперту, южноафриканскому профессору Кристофу Хайнсу, одному из крупнейших специалистов в мире по вопросам гуманитарного права, подготовить доклад о юридических аспектах использования боевых роботов. К.Хайнс блестяще справился с поставленной задачей.

В докладе К.Хайнса констатируется необходимость ввести мораторий на «производство, сборку, передачу, приобретение, внедрение и использование» автономных боевых роботов до тех пор, пока международная конференция не разработает соответствующие международные нормы и правила их применения[7].

Речь в докладе идет про автономные системы, способные вести бой без участия человека. К.Хайнс называл их (назвал так впервые и название прижилось) LARS (Lethal autonomous robotics — смертельные автономные роботы). По утверждению доклада, подготовленного ученым, «главная проблема в использовании таких систем состоит в снижении ценности человеческой жизни оппонента»[8]. Более того, использование таких систем в конфликтах против стран, не обладающих схожими технологиями, может привести к катастрофическим для этих стран последствиям. Как подчеркнуто в докладе пока нет соответствующих международных норм, остается неясным, можно ли запрограммировать роботов таким образом, чтобы они действовали «в соответствии с международными гуманитарными нормами» — в частности, отличали бы мирных жителей от военнослужащих. К.Хайнс также выразил опасение, что применение автономных роботов повлечет за собой уменьшение ответственности человека за свои действия.

Доклад, посвященный таким системам, появился также на сайте Управления Верховного комиссара ООН по правам человека 29 мая 2013 года: «23rdsessionoftheHumanRightsCouncil, onthetopicoflethalautonomousrobotics. It was delivered on behalf of the High Representative by Mr. Jarmo Sareva, Director of the Geneva Branch of UNOD».

Обсуждения в ООН темы LARS ведутся, однако ООН пока лишь рассматривает возможность запрета разработок определенных типов автономных боевых систем. Ведутся обсуждения и на других площадках, и в ряде международных организациях.

Международный Комитет Красного Креста (МККК) увидел в происходящем негативные тренды, и начал работу по проблеме автономных вооружений. «Возрастающая автономность несет в себе опасность того, что вместо людей решения будут принимать машины и, таким образом, будет постепенно ослабевать контроль человека над применением силы. Хотя признается, что окончательный контроль останется за людьми, необходимо более подробное обсуждение того, что такое достаточный, эффективный или надлежащий контроль человека за применением силы»[9], - указывается в документе МККК «Автономные системы вооружения: вопросы и ответы». А еще в марте 2014г. МККК созвал международное совещание экспертов для того, чтобы активизировать обсуждение этой проблематики.

Известная организация «Amnesty International» также выступила против создания кибернетических автономных убийц. В своём заявлении на заседании 16 апреля 2015 года, посвящённом Конвенции ООН о запрещении или ограничении применения конкретных видов обычного оружия, организация призвала принять превентивный запрет на разработку, накопление, передачу, развёртывание и использование полностью автономных систем оружия (АСО или роботов-убийц)[10].

Пока в международном гуманитарном праве нет специальных положений, касающихся боевых автономных систем. Возникают непростые вопросы, требующие ответов. Как и какими принципами обеспечить контроль нападений автономных роботов и исключить неизбирательность? Может ли право определить статус лиц, которые управляют военными роботами с расстояния в несколько тысяч километров от поля боя? Могут ли автономные боевые роботы обеспечить необходимый уровень избирательности при нападениях, которое диктует международное гуманитарное право?

Некоторые ученые-правоведы полагают, что здесь можно применить Женевскую конвенцию от 1949 года. Особо важное значение, по мнению юристов-международников, имеет так называемая Оговорка Мартенса от 1907 года к Гаагской конвенции, которая запрещает использовать оружие, противоречащее «принципам гуманности и требованиям общественного сознания». Как известно, система искусственного интеллекта не способна выносить субъективные оценки по определению. Надо напомнить, что автор «Оговорки» - крупный русский дипломат, юрист-международник Федор Федорович Мартенс (1845-1909гг) и именно это предложение, содержит Вступительная часть IV Гаагской конвенции 1907 года, которое, само по себе, придает этому документу и по сей день выдающееся значение.

Третья революция в военном деле началась?

Наблюдаемый в последние 40–50 лет удивительный прогресс в сфере автоматизации и развития информационных технологий не мог не сказаться и на создании новых, перспективных образцов вооружений. Сегодня развиваются одновременно концепции так называемых сетецентрических войн, в которых скачкообразно повышена информационно-коммуникационная связность подразделений, и особую роль приобретают системы боевого управления и интеграции разных видов вооруженных сил на едином поле боя. В направлении все большей автоматизации идет и процесс создания новых образцов вооружений

Не затрагивая сейчас технических аспектов проблемы, хотелось бы затронуть аспект политический. А именно – изменение характера войны и ее влияния на общественное сознание. Например, сегодня мы видим как, Соединенные Штаты ведут необъявленные, «дистанционные» войны.

Речь идет о системе оперативных баз США, развернутых практически по всему миру, на которых расположены американские БПЛА различных модификаций. БПЛА управляются операторами, сидящими, даже не в командном центре в США, а, как мы узнали благодаря разоблачениям Э.Сноудена, в специальных управляющих центрах на американских военных базах в Германии.

Таким образом, только небольшой шаг отделяет нас от третей революции в военном деле – от появления автономного оружия поля боя. Не секрет, что целый ряд стран хочет стать обладателями автономных вооружений. Компании в США, Соединённом Королевстве, Иордании, Израиле, Испании, Южной Корее, Японии, в других странах уже занимаются разработкой «менее летального» роботизированного оружия для использования в правоохранительной деятельности, которое либо управляется удалённо, либо стреляет автоматически при прикосновении[11].

Некоторые страны работают над более серьезными программами в этой сфере. Прежде всего, это – США. Потому что именно эта страна находятся сегодня на пике научно-технического могущества и стремится использовать это преимущество для отрывного наращивания своего военно-политического потенциала. Вот как рисует себе картину американского военного воздействия на противника в близком будущем заместитель министра обороны США Роберт Уорк: «системы, требующие вмешательства человека, не сумеют отразить первый удар. Машинам придется самостоятельно сдержать атаку и отразить ее буквально за микросекунды. Нам также потребуется высокая степень взаимодействия человека с машиной, подобно игре человека с использованием компьютерной программы для анализа позиции, когда машины, используя анализ больших данных, будут информировать людей, принимающих решения на поле боя. …В результате принятые решения будут более качественными, чем если бы люди принимали их без участия машин — или же машины без участия людей. Вам потребуются стандартные системы, с участием или без участия оператора. У вас будут все более сложные автономные безоператорные системы. Все это у вас будет. Поэтому мы полагаем, что военные действия в будущем будут характеризоваться очень высоким уровнем симбиоза человека и машины, когда простые платформы будут контролировать рои недорогих автономных систем, которые можно объединить в зависимости от обстоятельств и ввести в бой в больших количествах»[12].

Сегодня в США работают над большим числом проектов военных роботизированных платформ и военных роботов, а так же над проектами автономного оружия, возможно не только разведывательного характера.

Среди возникающих в различных конструкторских бюро США прототипов - беспилотный летательный аппарат «ShadowHawk», разрабатываемый американской компанией «Vanguard Defense Industries». Аппарат «ShadowHawk» спроектирован для того, чтобы выполнять функции, аналогичные тем, что выполняет разведывательный вертолёт, однако его можно оснастить оружием.

«ShadowHawk» американскойкомпании «Vanguard Defense Industries»

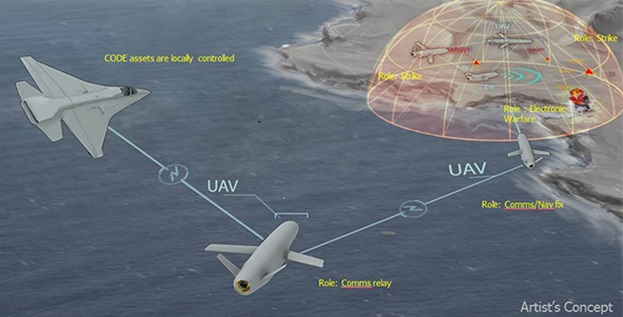

Знаменитая американская DARPA (Defense Advanced Research Projects Agency — Агентство передовых оборонных исследовательских проектов Министерства обороны США) сегодня ведет две основные программы по созданию автономного оружия. Это Fast Lightweight Autonomy (FLA) - Быстролетающий легкий автономный робот и Collaborative Operations in Denied Environment (CODE) – Автономные взаимодействующие роботы в оспариваемом воздушном пространстве.

Первая программа FLA касается разработки маленького вертолета, который сможет полностью самостоятельно действовать в городской среде и внутри зданий. Целью программы FLA говорится в документе DARPA, «является изучение нетрадиционных методов восприятия и методов автономии, которые позволили бы создать новый класс минималистичных алгоритмов навигации при движении на высокой скорости и в условиях перегрузок»[13]. Благодаря этому исследованию, программа направлена на развитие и демонстрацию возможностей для малого (то есть способного влететь в обычное окно) автономного БПЛА, который сможет летать на скоростях до 20 метров в секунду при отсутствии связи с оператором и без привязки к опорным точкам GPS.

«Хищные птицы и летающие насекомые дают нам пример того, какие возможности мы хотим для небольших беспилотных летательных аппаратов»[14],- заявил М.Мисайя, руководитель программы FLA DARPA. Как полагает руководитель программы FLA, «ястреб-тетеревятник, например, может летать очень быстро через густой лес без того чтобы столкнуться с деревом. Многие насекомые тоже могут летать и набрасываться на добычу с невероятной скоростью и точностью. Целью программы FLA является изучение нетрадиционных методов восприятия и автономии»[15], Такие неординарные возможности могут дать небольшим беспилотным летательным аппаратам способность летать с большой скоростью, огибая многочисленные препятствия, а также возможность легко ориентироваться в ограниченном пространстве и даже быстро распознавать его, если робот уже был здесь прежде.

Аппарат FLA на натурных испытаниях. Пунктирная линия – его траектория полета со скоростью 20 метров в секунду. (Фото DARPA)

Как указано в программе DARPA CODE большинство современных систем требуют постоянного контроля по выделенному каналу связи с БПЛА. С помощью телеметрии и участия в этом пилота-оператора и большого числа аналитиков, БПЛА обычно выполняет свои миссии. Такие требования жестко ограничивают масштабы и экономическую эффективность операций БПЛА. Работа DARPA по программе «Автономные взаимодействующие роботы в оспариваемом воздушном пространстве», в пространстве, где отсутствует связь с оператором, направлены на разработки принципиально новых алгоритмов и программного обеспечения беспилотных автономных летательных модулей. Эти разработки позволят расширить возможности миссии действующих американских БПЛА для увеличения возможностей американских ВВС по проведению операций.

«Так же, как волки охотятся в единых стаях с минимальным общением, группа беспилотных летательных аппаратов CODE будет обмениваться информацией и помогать друг другу, чтобы найти пути, определить и поразить цели, причем вся группа будет работать под командованием одного человека - руководителя миссии»[16], - заявил Жан-Шарль Леде, менеджер программы CODE DARPA. Предусмотрено, что улучшения автономии БПЛА поможет одному оператору проводить операции БПЛА в группе с шестью и более БПЛА одновременно. «Цель программы состоит также в создании летательных аппаратов, действующих автономно на всех этапах боевых миссий от поиска, слежки, идентификации цели и атаки»[17]. Система при этом будет предназначена для функционирования в ситуациях, когда из-за глушения радиосигнала связь с командным центром и с оператором становится невозможной.

Схема действия программы CODEDARPA. Автономные взаимодействующие роботы по приказу боевого пилота действуют в оспариваемом пространстве. (Фото DARPA)

Как считают специалисты DARPA, автономные взаимодействующие роботы-БПЛА в своем боевом применении будут находить цели и, в соответствии с поставленными задачами, с минимальным контролем со стороны оператора будут динамически адаптироваться к складывающейся обстановке, приходить на помощь к своим измотанным в боях частям или участвовать в парировании неожиданно возникших угроз. Планируется, что примерно шестью автономно взаимодействующими роботами-БПЛА будет одновременно управлять один офицер/оператор. Командиры смогут смешивать и сочетать различные системы автономно взаимодействующих роботов-БПЛА с конкретными возможностями, которые определяют отдельные миссии, а потери в живой силе и технике при этом, полагают в DARPA, резко уменьшатся.

Конечно, о прямых боевых функциях автономных роботов предпочитают не говорить вслух. Но, тем не менее, это следует из заявления директора Управления оборонных программ DARPA С.Томпкинса: «Операции по ликвидации городских и стихийных бедствий будут, очевидно, главными бенефициарами наших программ, но приложения для этой технологии могут распространяться на широкий спектр задач с использованием малых и больших беспилотных систем, связанных с пилотируемыми платформами как системами систем»[18].

Новая гонка вооружений не неизбежна

Как мы видим, исследования, НИОКРЫ и ОКРЫ по созданию автономных боевых роботов идут полным ходом. И не только в США. Недавно СМИ сообщили, например, о создании автономного робота-охранника в Южной Корее. Продвигаются такие разработки и в других государствах. И это очень опасные разработки.

Автономное оружие может включать в себя, например, вооруженные квадрокоптеры, которые могут разыскивать и ликвидировать людей, отвечающих определенным заранее определенным критериям. Но автономное оружие это не крылатые ракеты или беспилотные дроны, которыми управляют люди. Международное право пока не имеет определений этого нового вида оружия уничтожения – автономного оружия. Однако научно-технический прогресс в области вооружений приводит к тому, что решения на применение силы на поле боя всё чаще могут приниматься машинами, работающими без вмешательства человека. Здесь важно не перейти некую очень размытую грань. Черту, линию, разделяющую два возможных сценария будущего – позитивного будущего и катастрофичного. Ряд международных и неправительственных организаций видят потенциальную опасность. «Технологии дошли до такого уровня, на котором эти системы можно на практике внедрить в течение года, а уже не лет»[19], — подтверждает Стюарт Рассел известный специалист в области вычислительной техники из Калифорнийского университета в Беркли. По поводу развертывания армии автономных роботов поля боя С.Рассел предлагает два гипотезы: «Возможно, они будут чрезвычайно маленькие, но способные застрелить кого-нибудь или же они смогут размещать миниатюрные заряды прямо на черепе человека. Одного грамма взрывчатки достаточно, чтобы сделать отверстие в листе металла. Вероятно, этого будет достаточно»[20]. По оценкам С.Рассела, со всеми инновациями и разработками, в рамках возможной гонки вооружений будут выработаны системы небольшой стоимости - до десятков долларов за штуку. Развернуть такое оружие и приказать ему убивать любого, кто держит оружие, будет дешево и эффективно. «Независимо от того, как закончится эта гонка, становится понятно, что у людей нет ни шанса»[21]. В статье, публикованной в журнале «Nature», С.Рассел подчеркивает, что главная проблема, связанная с LARS касается возможностей применения этого вида оружия для совершения военных преступлений. С.Рассел считает, что ряд прототипов LARS уже поступили в специальные части ряда армий. Например, дрон «Harop», разработанный в Израиле, и предназначенный для поиска радаров на территории противника, при обнаружении источника излучения врезается в него и детонирует.

Прогресс систем искусственного интеллекта в военной сфере способен, безусловно, повысить конфликтность на планете, породить волну военных инцидентов, расширить во много раз возможности террористов и экстремистов всех мастей, и, наконец, дать новый импульс мировой гонке вооружений. Никто их ученых не может предсказать последствий создания вооруженного искусственного интеллекта и его будущих отношений с человечеством. Поэтому призыв из Буэнос-Айреса выдающихся мировых ученых в сфере искусственного интеллекта и робототехники к мировой общественности, ООН и, конечно, к дипломатическому сообществу всех государств, должен быть обязательно услышан.

[1] 24-я Международная объединенная конференция по искусственному интеллекту прошла с 25 июля по 1 августа, 2015 в Буэнос-Айресе, Аргентина. Международная объединенная конференция по искусственному интеллекту - International Joint Conferences on Artificial Intelligence (IJCAI) - это серия международных конференций - основное место сбора исследователей, занимающихся вопросами искусственного интеллекта. Периодичность: раз в два года (по нечетным годам), с 2016 года – ежегодно. Проводится с 1969 года в различных странах. Спонсорами конференций являются IJCAI и Ассоциации по искусственному интеллекту принимающих стран. В ходе конференций проходят пленарные и секционные доклады, сообщения со стендовыми докладами, выступления на круглых столах, а также выставки интеллектуальных продуктов (Подробнее: http://aihandbook.intsys.org.ru/index.php/activity/confs-list/186-conf-3)

[7]Report of the Special Rapporteur on extrajudicial, summary or arbitrary executions, Christof Heyns. Документ ООН A/HRC/23/47

[8]Report of the Special Rapporteur on extrajudicial, summary or arbitrary executions, Christof Heyns. Документ ООН A/HRC/23/47

Читайте другие материалы журнала «Международная жизнь» на нашем канале Яндекс.Дзен.

Подписывайтесь на наш Telegram – канал: https://t.me/interaffairs

00:00 19.08.2015 •

00:00 19.08.2015 •